机器之心报道

编辑:张倩

「在谷歌,我们训练出了越来越大的 Transformer,梦想着有朝一日构建一个通用模型来支持所有 ML 用例。但是,这其中有一个明显的局限:用文本训练出的模型可以写出很棒的散文,但它们无法在数字世界中采取行动。你不能要求 GPT-3 给你订机票,给供应商开支票,或者进行科学实验。」

在一场轰轰烈烈的「炼大模型」运动之后,全世界都在给这些模型寻找应用途径和场景,原谷歌大脑研究人员、Transformer 重要作者 Ashish Vaswani、 Niki Parmar 也不例外。

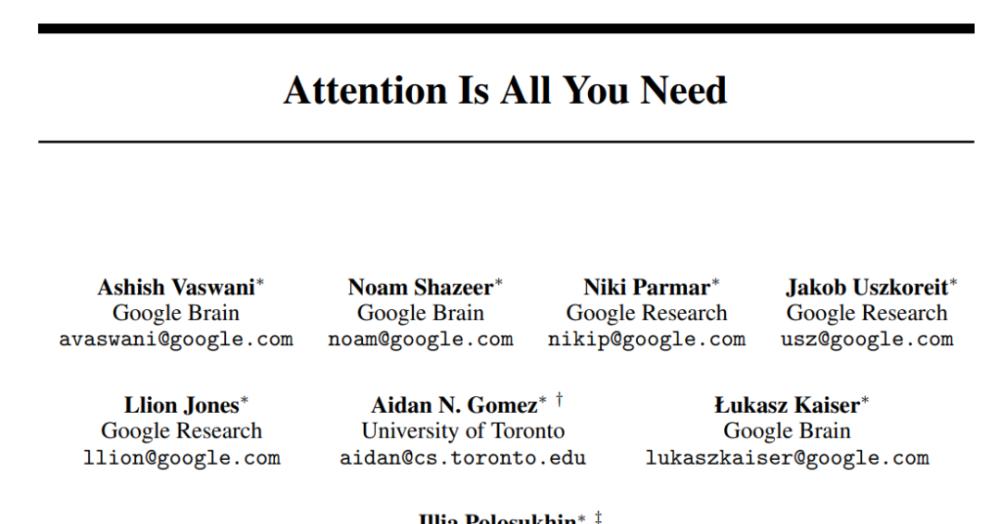

2017 年,Ashish Vaswani、Niki Parmar 和其他几位研究者一起发表了开启大模型时代的里程碑式论文——《 Attention Is All You Need 》。在这篇论文中,他们提出了著名的 Transformer 架构。2018 年,一个名为 BERT 的模型引爆了 NLP 学界,刷新了 11 项 NLP 任务的 SOTA 记录,其背后功臣正是 Transformer。

Ashish Vaswani、Niki Parmar 等人 2017 年发表的《 Attention Is All You Need 》。注意: 表示这些研究者做出了不同方面但同等重要的贡献(排名随机)。其中,Ashish 和 Illia 一起设计并实现了第一批 Transformer 模型,并重度参与了 Transformer 架构的各方面工作。Niki 在原始代码库和 tensor2tensor 中设计、实现、调优和评估了无数的模型变量。

在之后的几年里,Transformer 成为自然语言处理领域的主流架构,而且成功跨界到了视觉、音频处理等多个领域,标志性的「xxx is all you need」也成为火爆一时的标题模板。

五年过去,Ashish Vaswani、Niki Parmar 决定踏上新的征程。在最近发布的推文中,他们宣布自己参与创办了一家新的创业公司——Adept,致力于让人和计算机以创造性的方式一起工作,从而实现通用智能。「我们相信,人工智能系统应该以用户为中心,我们的愿景是让机器与坐在驾驶员位置上的人一起工作:发现新的解决方案,使决策更加明智,并给我们更多的时间做我们喜欢的工作。」该公司在介绍中写道。

除了 Ashish Vaswani 和 Niki Parmar,该公司还聚集了多位 AI 领域的顶级研究者(基本都在谷歌工作过),包括:

前谷歌大脑研究工程师 Anmol Gulati,他参与了谷歌的大规模语音和语言建模研究;

前谷歌大脑研究科学家 Augustus Odena,他参与构建了谷歌的代码生成模型;

前 OpenAI 加州实验室工程副总裁 David Luan,后来也加入过谷歌大脑,他是 GPT-2、PaLM (https://mp.weixin.qq.com/s/-Annt2JkAhgv9YxYpc7pXQ) 的论文作者之一,还参与了 GPT-3 的部分工作;

在 DeepMind、谷歌大脑、百度都工作过的 Erich Elsen,他是机器学习和高性能计算交叉领域的研究人员,在 DeepMind 参与领导大模型的训练工作,致力于提高训练效率;

前谷歌大脑软件工程师 Fred Bertsch,他是数据和协作人工智能系统方面的专家;

前谷歌 ML 产品经理 Kelsey Schroeder,她曾领导谷歌大模型生产基础设施产品;

曾在谷歌大脑实习的 MIT 博士 Maxwell Nye,他的研究重点是使用深度学习和符号技术来自动编写代码。在谷歌实习期间,他曾使用非常大的语言模型(> 1000 亿个参数)来编写和理解 Python 程序。

Adept 创始团队。

那么,这些大牛为什么要离开谷歌这种大厂自己创业呢?他们的新公司要做什么产品呢?

David Luan 在公司的第一则博客中写道:

在谷歌,我们训练出了越来越大的 Transformer,梦想着有朝一日构建一个通用模型来支持所有 ML 用例。但是,这其中有一个明显的局限:用文本训练出的模型可以写出很棒的散文,但它们无法在数字世界中采取行动。你不能要求 GPT-3 给你订机票,给供应商开支票,或者进行科学实验。

真正的通用智能要求模型不仅能读能写,还能以一种对用户有帮助的方式采取行动。这就是我们创立 Adept 的初衷:我们正在训练一个神经网络来使用世界上的每一款工具和 API,该网络建立在人们已经创造的大量现有能力的基础上。

实际上,我们正在创建一个通用系统,帮助人们在电脑前完成工作,我们管这个系统叫:每个知识工作者的「通用合作者」。你可以把它想象成你电脑里的一个 overlay,它和你一起工作,使用和你一样的工具。

使用 Adept,你能专注于你真正喜欢的工作,并要求模型承担其他任务。例如,你可以要求模型「生成月度合规报告」,所有这些都使用现有的软件,如 Airtable、Photoshop、ATS、Tableau、Twilio。我们希望这个「合作者」是一个好学生,可训练性非常强,非常有帮助。

这一产品愿景让我们兴奋不已,不仅因为它对每个在电脑前工作的人来说都非常有用,还因为我们相信这是实现通用智能最实用、最「安全」的途径。与生成语言或自行决策的大型模型不同,我们的模型范围更窄——我们是现有软件工具的接口,更容易缓解偏见问题。对我们公司来说至关重要的是,我们的产品如何成为一种工具,来了解人们的偏好,并在每一步中整合人类的反馈。

从这则博客中我们可以看出,Adept 虽然也宣称要实现 AGI,但他们选择的是一条不同的道路,即先不着急用 AI 取代人类,而是致力于用 AI 来增强人类的能力,这听起来似乎更容易实现。

当然,这并不是什么新鲜概念。《深度学习》一书作者、被称为「世界 AI 之父」的特伦斯 · 谢诺夫斯基(Terry Sejnowski)早在 2019 年就说过,「在未来,人类与机器将是合作而非竞争关系」。作为实现 AGI 之前的过渡阶段,「协作智能」的概念越来越受关注。澳大利亚最大的国家级科研机构——CSIRO 首席研究科学家 Cécile Paris 甚至指出,「(协作智能)将成为数字化转型的下一个科学前沿」。目前,国内外都涌现了很多以「用 AI 增强人类能力」为愿景的技术公司,比如循环智能、容联云等。在真正的 AGI 实现之前,可能会有越来越多的公司选择这条路线。

David Luan 透露,目前 Adept 已经拿到了 6500 万美元的融资,Uber CEO Dara Khosrowshahi、特斯拉 AI 高级总监 Andrej Karpathy 等人都是他们的天使投资人。

参考链接:https://www.adept.ai/post/introducing-adept