2018 IEEE

Xiang Wu, Ran He, Zhenan Sun and Tieniu Tan

一、簡介

本文提出了一個輕量級的CNN架構來學習帶有大量噪聲标簽的大規模人臉資料的緊湊嵌入。

我們在CNN的每個卷積層引入一種稱為最大特征映射(MFM)的最大輸出激活變體。與使用許多特征映射來線性逼近任意凸激活函數的最大化激活不同,MFM是通過競争關系來實作的。MFM不僅可以分離噪聲信号和資訊信号,還可以在兩個特征圖之間起到特征選擇的作用。

三個網絡被精心設計以獲得更好的性能,同時減少參數數量和計算成本。

提出了一種基于預處理深層網絡的語義自舉方法來處理大規模資料集上的噪聲标記圖像,使網絡預測與噪聲标簽更加一緻。不一緻的标簽可以通過預測的機率有效地檢測出來,然後重新标記或者移除進行訓練。

二、Max-Feature-Map(MFM)

MFM使用max函數來抑制少量神經元的激活。MFM被設計出來要實作以下三個特性:

- 由于大規模資料集通常包含各種類型的噪聲,我們希望噪聲信号和資訊信号能夠被分離開。

- 當圖像中存在水準邊緣時,對應于水準資訊的神經元被激發,而對應于垂直資訊的神經元被抑制。

- 對一個神經元的抑制是無參數的,是以它不廣泛依賴于訓練資料。

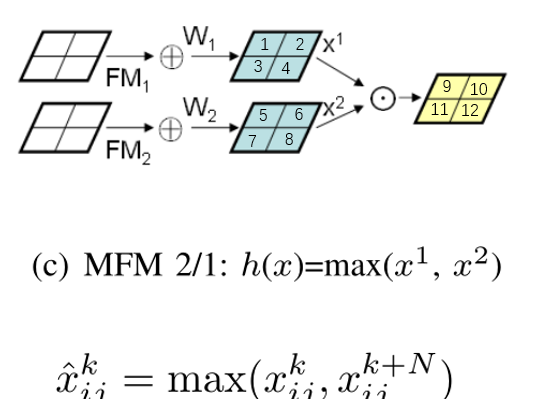

MFM2/1的運算是組合兩個特征圖,然後一一對應的按元素輸出最大值。

MFM2/1通過跨特征通道的元素最大化操作方式從輸入特征圖中獲得50%的資訊神經元。

例如,輸出特征圖中9這個位置的值就是取特征圖一中1位置的值與特征圖二中5位置的值之間的最大值。

MFM3/2是為了獲得更具可比性的特征圖,輸入三個特征圖并逐個元素的去除最小一個元素。

MFM3/2從輸入的特征圖中選擇保留2/3的信号。

帶有MFM的CNN可以獲得緊湊的表示,而MFM層的梯度是稀疏的。由于MFM的梯度稀疏性,一方面,在訓練階段做反向傳播時,随機梯度下降隻能對響應變量的神經元産生影響;另一方面,當提取用于測試的特征時,MFM可以通過激活兩個特征映射的最大值來從先前的卷積層獲得更多的競争節點。這證明了MFM可以執行特征選擇并促進生成稀疏連接配接。

三、三種架構

LightCNN-4:

LightCNN-4由4個MFM的卷積層和4個maxpool層組成。

LightCNN-9:

LightCNN-9由5個卷積層、4個1×1卷積層、4個MFM層和4個maxpool層。

1×1的卷積層可以潛在的在卷積層之間進行特征選擇,并且減少了參數。

LightCNN-29:

将殘差塊的思想引入到LightCNN中。

殘差塊包含兩個3×3的卷積層和兩個沒有批量歸一化的MFM運算。

殘差塊去除批量歸一化。盡管批量歸一化對于加速訓練的收斂和避免過拟合是有效的,但是在實踐中,批量歸一化是特定于領域的,當測試樣本來自于訓練資料不同的領域時,這可能是失敗的。