文 | 阿裡雲異構計算團隊

近日,斯坦福大學DAWNBench ImageNet最新成績公布,阿裡超過Google、Facebook等,摘下四個榜單的世界第一。

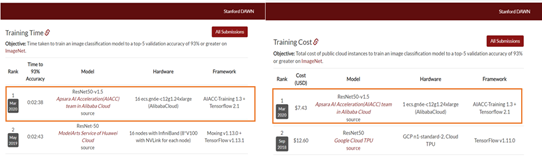

128卡V100上,訓練ResNet50,隻需要158秒就能獲得top5 93%的精度。

在10000張圖檔的驗證集進行圖檔分類,top5精度不低于93%,推理性能比第二名快5倍以上。

可以說,不論是訓練的性能和成本,還是推理的性能和成本,都展現出阿裡在異構計算領域具有世界級AI軟硬體一體化極緻性能優化能力。

阿裡是如何做到的?四項冠軍得主——阿裡雲異構計算團隊分享了背後的技術秘密。

這是一個什麼樣的成績?

斯坦福的DAWNBench,是一個端到端的深度學習模型訓練和推理性能的基準測試平台,由斯坦福大學在2017的NIPS會議上釋出,之後得到業界廣泛支援。

Google、Facebook和VMWARE等世界知名公司先後加入。DAWNBench已成為人工智能領域最具影響力、最權威的排行榜單之一。

對于AI計算而言,最重要的兩個名額是性能和成本。最新的成績公布後,顯示了阿裡雲在訓練和推理領域軟硬體一體化世界級性能優化能力。

阿裡雲異構計算AI加速團隊透露,最重要的武器是阿裡雲自研的飛天AI加速引擎AIACC、阿裡雲自研晶片含光800(簡稱AliNPU)以及阿裡雲異構計算雲服務。

AIACC是阿裡雲自研的AI加速引擎,是業界首次統一加速Tensorflow、PyTorch、MxNet、Caffe、Kaldi等AI主流計算架構的加速引擎,其中包括訓練加速引擎AIACC-Training和推理加速引擎AIACC-Inference。

訓練加速引擎針對分布式的網絡做了性能優化,能夠充分發揮分布式網絡的通信能力,推理加速引擎針對阿裡雲異構計算雲服務(包括GPU雲服務和NPU雲服務)做了針對性深度的性能優化,能夠發揮異構加速裝置的計算能力。

以NVidia GPU為例,目前業界最快的推理引擎是TensorRT,而AIACC-Inference的計算性能比TensorRT還能獲得1.5~2.5倍的性能加速比。

含光800是阿裡巴巴第一顆自研AI晶片,也是全球性能最強的AI推理晶片,主要用于雲端視覺處理場景,性能打破了現有AI晶片記錄,性能及能效比全球第一。

在業界标準的ResNet-50測試中,含光800推理性能達到78563 IPS,比目前業界最好的AI晶片性能高4倍;能效比500 IPS/W,是第二名的3.3倍,而AIACC-Inference也能夠充分揮發含光800超高的計算能力,這是阿裡雲軟硬體一體化極緻性能優化的典範。

阿裡雲異構計算雲服務将GPU、FPGA、NPU等異構計算裝置整合,通過雲計算服務的方式對客戶提供異構計算服務。

随着人工智能浪潮的興起,越來越多的AI計算都采用異構計算來實作性能加速,而阿裡雲異構計算服務,建構于雲上最豐富的加速執行個體基礎之上,通過AIACC的算力提升,為AI計算提供普惠、彈性和觸手可得的加速計算雲服務。

重新整理ImageNet上ResNet50的訓練記錄

在圖像識别領域,最具代表性的場景是ResNet50在ImageNet上的訓練。

最新公布的榜單上,AIACC-Training成為此場景下的性能與成本的世界雙項第一,展示了在分布式訓練領域AIACC處于國際領先水準,能夠幫助使用者提升訓練性能的同時降低所需的計算成本。

訓練性能榜單新的世界紀錄,運作在128張V100(16台異構計算雲服務執行個體ecs.gn6e-c12g1.24xlarge)的叢集之上,網絡通信為32G VPC,訓練ResNet50 至top5精度達到93%時間為2分38秒。

此前的世界紀錄所采用的叢集規模也是128張V100,網絡通信則為100G InfiniBand網絡,是本次打破世界紀錄的32G VPC的3倍的帶寬。異構計算雲服務的典型網絡配置為32Gbps帶寬的VPC網絡,為了更貼近最終使用者的場景,阿裡選擇的是VPC網絡。

32G VPC網絡與前世界紀錄的網絡實體帶寬上的巨大差距是團隊面臨的重大挑戰,我們從兩個大的方向作了深入的優化:

第一個方向是從模型本身的優化上,進行超參的調整以及optimizer的改進,減少達到93%精度情況下所需要進行的疊代數,同時也要盡力提升單機的性能。

第二個方向是分布式性能優化,我們采用團隊自研的飛天AI加速引擎AIACC-Training(原Ali-Perseus-Training)作為分布式的通信庫,充分挖掘32G VPC的所有潛力。

最終兩個方向的極緻優化相疊加,超越了一個看似不可能達到的性能屏障,以較低的網絡帶寬,創造了新的世界紀錄。

同時,因為分布式訓練部署本身的複雜性,為了提高效率,也為了友善外部使用者重制結果,阿裡團隊使用了之前開發的即刻建構的工具FastGPU,将叢集的建立和分布式訓練的排程全部以腳本的方式完成,可以一鍵啟動,大大加快了優化工作的效率。

未來,我們會開源基于AIACC的benchmark代碼,友善外部使用者一鍵複現結果。

分布式訓練領域近年來發展迅猛,有多種可供選擇的解決方案,對于Tensorflow 而言,架構本身支援PS模式以及Ring allreduce風格的分布式通信,第三方的支援有Horovod。

對于ResNet50的分布式訓練,開源方案中Horovod依然是相對最優的解決方案,是以,阿裡以Horovod作為對比的baseline。

分布式訓練的邏輯框圖如下圖所示:

最小計算節點為單張GPU卡,每個計算節點都會從總的資料集中劃分一份資料作為本節點的訓練資料,然後開始前向和後向的計算,在後向計算結束後會得到目前batch所産生的梯度。

然後在更新參數之前,需要在整個叢集上進行梯度通信。Horovod API就是在梯度更新之前,在optimizer這個環節插入了一段多節點間的通信的流程。

AIACC-Training

AIACC-Training是阿裡雲自研的深度學習分布式訓練通信引擎,統一支援Tensorflow、PyTorch、MxNet和Caffe,從IaaS層面提供可被內建且相容開源的加速庫。

現在已經有多家AI和網際網路客戶在生産環境中大量部署使用,顯著提升異構計算産品的成本效益,從軟體層面為客戶提供差異化的計算服務,架構如下圖所示。

AIACC-Training 作為此次Dawnbench 記錄的分布式後端,發揮了至關重要的作用。以下是我們對AIACC-Training背後的分布式優化作詳細的解析。

去中心化梯度協商

分布式性能的關鍵就是如何優化這個通信環節的效率,對于ResNet50而言,我們需要通信的梯度資料大約是170個,而通信的總量大約是50MB。

這些梯度的産生時機依賴于它們各自在計算圖中的位置,計算圖中存在依賴關系的部分梯度決定了這一部分梯度被計算出來的時間先後順序。

而在計算圖中處于互相之間完全無依賴的算子的,它們在每次計算發生的時機具有一定的随機性。在多節點間通信要解決的第一個問題就是需要協商梯度的同步順序。

Horovod中所采用的的方法是以0号節點為中心,與所有其它節點進行點對點的通信确定目前所有節點上都已經就緒的梯度,然後再0号節點上确定這些就緒梯度上如何去通信,最後将通信政策點對點的發送到每一個其它節點,之後根據通信政策開始進行多機通信。

這一點對點的協商政策,在128節點下,對0号節點,造成了一個局部的熱點,需要通信256次。AIACC-Training 放棄了這種中心節點的協商模式,轉而采用了去中心化的方式在128個節點間進行協商,因為128個節點實際分布在16台執行個體中,我們的優化可以輕易的識别這種拓撲結構,不再會在任何單個GPU卡上産生256次通信熱點。

考慮到大部分時候ready的不止一個梯度,這種優化還能夠同時對多個梯度進行協商,是以實際降低協商的通信量大約一個數量級。

細粒度梯度融合

梯度協商之後,所有節點都知道了目前這個時刻可以進行通信的梯度,接下來面臨的一個優化問題是,我們是要在收集到任意數量的梯度之後立刻對所有的梯度進行通信,還是選擇某個更優化的組合方式來通信。

這裡一個确定性結論是,對單個梯度進行單次通信,通信效率總是非常低下的,我們需要進行多個梯度的融合,然後再對融合後的更大的粒度上進行通信。

AIACC-Training 引入了細粒度的融合政策,我們會在通信環節去動态分析目前的通信狀況進而選擇一種更平衡的融合政策,避免出現過大的差異。

這樣會使得每次通信的粒度盡量均勻,減小出現大幅波動的可能。因為這種融合政策對不同的網絡模型而言存在不同的最優值,是以們實作了自動優化的功能,會動态的調整此參數,尋找最優的融合粒度。

異步多流通信

底層的通信庫還是采用NCCL來進行GPU間的資料通信,NCCL的程式設計模型僅支援單一的通信流進行通信,而單一的通信流的效率很低,單流的轉發能力往往隻能達到10G bps左右。

AIACC-Training從更高的通信引擎層面支援了多流,會配置設定不止一個通信流來進行梯度通信,每個流服務于切分出來的某個融合梯度,而後續切分的融合粒度并不依賴于目前切分的融合梯度。

是以即使多流之間的通信是完全異步運作,即使多流之間的速度不均衡,也不會嚴重影響整體的效率,在規模擴大的時候,能更好的維持最佳的網絡帶寬使用率。

和融合粒度一樣,切分的流數,也會和訓練模型,以及目前的實際網絡帶寬有很強的相關性,是以無法離線的給出一個最優設定。

我們設計了自動tuning機制,将通信流數目加入了自動tuning環節,融合粒度以及切分的流數,會聯合自動tuning出最佳的參數組合。

模型優化

算法層面的優化主要可以分為資料、模型、超參和優化器四個方面。

資料上,我們采用了多分辨率圖像漸進訓練。這種方式不僅可以在前期利用小分辨率圖像大大提升前後向計算速度、又可以弱化訓練和推理時采用不同尺寸帶來的準确率損失。

模型上,我們吸收了近期一些網絡變體的優勢,也根據最新的一些研究對BatchNorm做了微弱的調整。

超參方面我們做了很多探索,如在學習率衰減的方式上,我們沒有用很流行的step decay或是cosine decay,而是采用了更直接的linear decay,另外我們也發現warmup的步數非常重要。

優化器上,我們重新設計了優化器方案,同時吸收了SGD的泛化性優勢和自适應優化器快速收斂,使得改進後的優化器訓練速度更快且準确率更高。

基于上述優化工作,我們在28個epoch 共1159次疊代下完成訓練并達到top5 93%的精度要求,而原來訓練則需要90個epoch才能達到相同的精度。

性能結果

結合以上所有性能優化,我們在128卡V100上,達到了158秒就能獲得top5 93%的精度,創造了新的世界紀錄。

重新整理推理性能記錄:比第二名快5倍以上

在推理項目中,DawnBench競賽要求推理架構針對ImageNet的10000張圖檔的驗證集進行圖檔分類,分類模型的top5精度不低于93%。

在batch size=1的配置下,計算推理每一張圖檔的平均時間和平均成本。在上一個性能紀錄中,平均推理時間隻有不到1ms,已經遠遠超過了人類視覺的反應速度。

在最新公布的榜單上,我們基于異構計算AliNPU雲服務執行個體(ecs.ebman1.26xlarge)奪得了推理性能項目的第一名,比第二名快5倍以上。

同時,之前送出的推理成本第一的成績(基于異構計算GPU雲服務執行個體ecs.gn6i-c8g1.2xlarge)目前還沒有人超越,是以在性能和成本兩個項目上均排名第一。

AIACC-Inference

在服務客戶和不斷沖擊DawnBench第一的過程中, 我們也在不斷打磨異構計算服務場景下的推理優化技術, 并根據客戶的實際需求研發了AIACC-Inference模型加速引擎,幫助客戶解決主流AI架構TensorFlow、PyTorch、MXNet、Kaldi等架構下的模型優化問題。

優化方法包括對模型的計算圖進行分析,将其中計算節點進行融合,減少模型中計算節點的個數,提升計算圖的執行效率。

同時提供了FP32和FP16及Int8精度的模型優化選項,可以生成多種精度下的優化模型,其中FP16和Int8精度模型可以利用NVIDIA Volta和Turing架構下的Tensor core硬體支援,進一步提升模型推理在V100, T4 GPU卡上的性能。

目前 AIACC-Inference 既支援常用的圖像分類和目标檢測模型,也支援Bert,StyleGAN這樣的NLP模型和GAN網絡模型。

此外,我們還深度優化了1x1、3x3、7x7卷積kernel,在AIACC-Inference中增加了新op的融合機制,比目前業界最快的TensorRT還能獲得1.5-2.5倍的性能加速比。

模型與架構優化

在上一次送出的版本中,我們将base模型換為更為精簡的ResNet26d,引領了一波風潮。

這一次為了進一步提高模型的精度并精簡模型,我們對超參數進行了調整,引入了更多的資料增強方式。通過使用了AugMix和JSD loss疊加RandAugment的組合方式,将ResNet26d模型的精度提升至93.3%,收獲0.13+%的精度收益。

基于含光800(AliNPU)的優化

我們針對AliNPU的架構特點,對推理引擎進行了相應的優化。由于AliNPU使用uint8作為存儲格式用于上傳和下載下傳資料。

是以需要在進入engine前後插入量化和反量化操作用于恢複資料,但是Quant和Dequant這些操作在CPU上,無法使用AliNPU加速,占據了一大部分的推理時間,通過在預處理和後進行中執行這些操作将推理延遲降低至0.117ms的水準。

考慮到我們使用的推理模型較小,依照GPU的經驗帶寬4GB/s,輸入一張圖檔需要将147KB的資料上傳至AliNPU中需要花費0.03ms。是以我們在架構中引入了preload機制,将資料預取入AliNPU中,将平均推理延遲進一步降低至0.0739ms。