本文偏向与实操层面的为大家介绍,如何基于阿里云数加streamcompute、datav快速构建网站日志实时分析。

【什么场景适合用流计算】

流计算提供了针对流式数据实时分析的一站式工具链,对于大量流式数据存在实时分析、计算、处理的逻辑可以考虑通过流计算该任务。举例如下:

1. 针对实时营销活动,需要实时获取活动流量数据分析以了解活动的营销情况,此时可以上流计算。

2. 针对物联网设备监控,需要实时获取设备数据进行实时灾难监控,此时可以上流计算。

3. 对于手机app数据实时分析,需要实时了解手机设备的各类指标情况,此时可以上流计算

【使用前须知】

为保障本教程的顺利的进行,须知晓如下使用前提:

具备阿里云账号(淘宝及1688帐号可直接使用会员名登录);

下载并安装logstash的datahub output插件。

【实现的业务场景】

数据来源于某网站上的http访问日志数据,基于这份网站日志来实现如下分析需求:

实时统计并展现网站的pv和uv,并能够按照用户的终端类型(如android、ipad、iphone、pc等)分别统计。

实时统计并展现网站的流量来源。

从ip中解析出region或者经纬度在地图上进行展示。

【说明】浏览次数(pv)和独立访客(uv)是衡量网站流量的两项最基本指标。用户每打开一个网站页面,记录一个pv,多次打开同一页面pv 累计多次。独立访客是指一天内,访问网站的不重复用户数,一天内同一访客多次访问网站只计算1 次。referer 可以分析网站访问来源,它是网站广告投放评估的重要指标,还可以用于分析用户偏好等。

【操作流程概述】

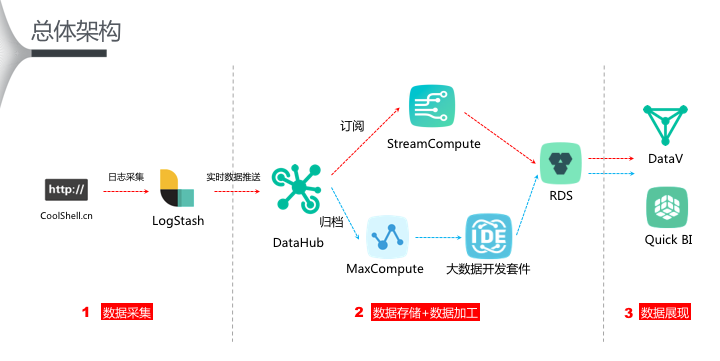

如上图所示,红色箭线部分为流式数据处理部分,主要拆解如下:

l 配置logstash,将网站产生的日志实时采集至datahub。

l 申请开通datahub,创建项目project及topic(datahub服务订阅和发布的最小单位)。

l 开通streamcompute,创建项目project及注册数据输入源(datahub)和输出源(rds),并创建流任务(stream sql任务)。

l 上一步骤中关于输出源rds的配置,需要事先购买rds for mysql资源。

l 申请开通datav,新建rds数据源并创建datav项目进入大屏制作。

【数据结构设计】

datahub topic: 分别创建topic为:coolshell_log_tracker、coolshell_log_detail、coolshell_log_fact。

rds:分别创建table为:

adm_refer_info、

adm_user_measures、

flyingline_coordinates ã

【网站日志实时解析】

配置前须知

阿里云流计算为了方便用户将更多数据采集进入datahub,提供了针对logstash的datahub output插件。

logstash安装要求jre 7版本及以上,否则部分工具无法使用。

操作步骤

步骤2 通过如下命令解压即可使用:

$ tar -xzvf logstash-2.4.1.tar.gz

$ cd logstash-2.4.1

<code>$ {log_stash_home}/bin/plugin install --local logstash-output-datahub-1.0.0.gem</code>

步骤4 下载geoip解析ip数据库到本地。

wget http://geolite.maxmind.com/download/geoip/database/geolitecity.dat.gz

步骤5 解压到当前路径并移动到logstash具体路径下。

步骤6 配置logstash任务.conf,示例如下:

配置文件为coolshell_log.conf。具体datahub topic信息可详见 数据存储 章节。

步骤7 启动任务示例如下:

【数据表创建】

附rds创建表ddl:

【流式数据处理】

注册数据存储包括datahub和rds:

按照数据链路图中来编写处理逻辑(附核心代码):

【处理逻辑1】

【处理逻辑2】

【处理逻辑3、4、5、6】

【上线stream sql】

上线任务后需要对任务进行启动:

【创建大屏】

现在datav中创建rds数据源:

然后根据如下拖拽如组件配置简单的sql:

本文主要讲述了实时场景的链路,后续也会将日志归档到maxcompute然后通过quick bi进行报表分析。敬请期待!