所謂網頁抓取,就是把URL位址中指定的網絡資源從網絡流中讀取出來,儲存到本地。

類似于使用程式模拟IE浏覽器的功能,把URL作為HTTP請求的内容發送到伺服器端, 然後讀取伺服器端的響應資源。

在Python中,我們使用urllib2這個元件來抓取網頁。

urllib2是Python的一個擷取URLs(Uniform Resource Locators)的元件。

它以urlopen函數的形式提供了一個非常簡單的接口。

最簡單的urllib2的應用代碼隻需要四行。

我們建立一個檔案urllib2_test01.py來感受一下urllib2的作用:

[python] view plain copy print ?

- import urllib2

- response = urllib2.urlopen('http://www.baidu.com/')

- html = response.read()

- print html

import urllib2

response = urllib2.urlopen('http://www.baidu.com/')

html = response.read()

print html

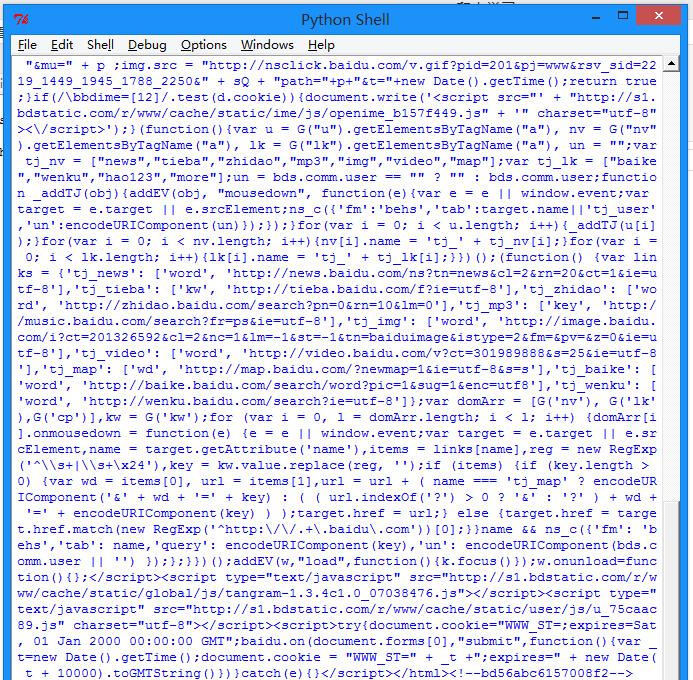

按下F5可以看到運作的結果:

我們可以打開百度首頁,右擊,選擇檢視源代碼(火狐OR谷歌浏覽器均可),會發現也是完全一樣的内容。

也就是說,上面這四行代碼将我們通路百度時浏覽器收到的代碼們全部列印了出來。

這就是一個最簡單的urllib2的例子。

除了"http:",URL同樣可以使用"ftp:","file:"等等來替代。

HTTP是基于請求和應答機制的:

用戶端提出請求,服務端提供應答。

urllib2用一個Request對象來映射你提出的HTTP請求。

在它最簡單的使用形式中你将用你要請求的位址建立一個Request對象,

通過調用urlopen并傳入Request對象,将傳回一個相關請求response對象,

這個應答對象如同一個檔案對象,是以你可以在Response中調用.read()。

我們建立一個檔案urllib2_test02.py來感受一下:

[python] view plain copy print ?

- import urllib2

- req = urllib2.Request('http://www.baidu.com')

- response = urllib2.urlopen(req)

- the_page = response.read()

- print the_page

import urllib2

req = urllib2.Request('http://www.baidu.com')

response = urllib2.urlopen(req)

the_page = response.read()

print the_page

可以看到輸出的内容和test01是一樣的。

urllib2使用相同的接口處理所有的URL頭。例如你可以像下面那樣建立一個ftp請求。

[python] view plain copy print ?

- req = urllib2.Request('ftp://example.com/')

req = urllib2.Request('ftp://example.com/')

在HTTP請求時,允許你做額外的兩件事。

1.發送data表單資料

這個内容相信做過Web端的都不會陌生,

有時候你希望發送一些資料到URL(通常URL與CGI[通用網關接口]腳本,或其他WEB應用程式挂接)。

在HTTP中,這個經常使用熟知的POST請求發送。

這個通常在你送出一個HTML表單時由你的浏覽器來做。

并不是所有的POSTs都來源于表單,你能夠使用POST送出任意的資料到你自己的程式。

一般的HTML表單,data需要編碼成标準形式。然後做為data參數傳到Request對象。

編碼工作使用urllib的函數而非urllib2。

我們建立一個檔案urllib2_test03.py來感受一下:

[python] view plain copy print ?

- import urllib

- import urllib2

- url = 'http://www.someserver.com/register.cgi'

- values = {'name' : 'WHY',

- 'location' : 'SDU',

- 'language' : 'Python' }

- data = urllib.urlencode(values) # 編碼工作

- req = urllib2.Request(url, data) # 發送請求同時傳data表單

- response = urllib2.urlopen(req) #接受回報的資訊

- the_page = response.read() #讀取回報的内容

import urllib

import urllib2

url = 'http://www.someserver.com/register.cgi'

values = {'name' : 'WHY',

'location' : 'SDU',

'language' : 'Python' }

data = urllib.urlencode(values) # 編碼工作

req = urllib2.Request(url, data) # 發送請求同時傳data表單

response = urllib2.urlopen(req) #接受回報的資訊

the_page = response.read() #讀取回報的内容

如果沒有傳送data參數,urllib2使用GET方式的請求。

GET和POST請求的不同之處是POST請求通常有"副作用",

它們會由于某種途徑改變系統狀态(例如送出成堆垃圾到你的門口)。

Data同樣可以通過在Get請求的URL本身上面編碼來傳送。

[python] view plain copy print ?

- import urllib2

- import urllib

- data = {}

- data['name'] = 'WHY'

- data['location'] = 'SDU'

- data['language'] = 'Python'

- url_values = urllib.urlencode(data)

- print url_values

- name=Somebody+Here&language=Python&location=Northampton

- url = 'http://www.example.com/example.cgi'

- full_url = url + '?' + url_values

- data = urllib2.open(full_url)

import urllib2

import urllib

data = {}

data['name'] = 'WHY'

data['location'] = 'SDU'

data['language'] = 'Python'

url_values = urllib.urlencode(data)

print url_values

name=Somebody+Here&language=Python&location=Northampton

url = 'http://www.example.com/example.cgi'

full_url = url + '?' + url_values

data = urllib2.open(full_url)

這樣就實作了Data資料的Get傳送。

2.設定Headers到http請求

有一些站點不喜歡被程式(非人為通路)通路,或者發送不同版本的内容到不同的浏覽器。

預設的urllib2把自己作為“Python-urllib/x.y”(x和y是Python主版本和次版本号,例如Python-urllib/2.7),

這個身份可能會讓站點迷惑,或者幹脆不工作。

浏覽器确認自己身份是通過User-Agent頭,當你建立了一個請求對象,你可以給他一個包含頭資料的字典。

下面的例子發送跟上面一樣的内容,但把自身模拟成Internet Explorer。

(多謝大家的提醒,現在這個Demo已經不可用了,不過原理還是那樣的)。

[python] view plain copy print ?

- import urllib

- import urllib2

- url = 'http://www.someserver.com/cgi-bin/register.cgi'

- user_agent = 'Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)'

- values = {'name' : 'WHY',

- 'location' : 'SDU',

- 'language' : 'Python' }

- headers = { 'User-Agent' : user_agent }

- data = urllib.urlencode(values)

- req = urllib2.Request(url, data, headers)

- response = urllib2.urlopen(req)

- the_page = response.read()