中文詞頻統計

1. 下載下傳一長篇中文小說。

2. 從檔案讀取待分析文本。

3. 安裝并使用jieba進行中文分詞。

ljieba.lcut(text)

4. 更新詞庫,加入所分析對象的專業詞彙。

jieba.load_userdict("D:\\dict.txt") #詞庫文本檔案

5. 生成詞頻統計

6. 排序

xu=list(stayed_line.items())

xu.sort(key=lambda x:x[1],reverse=True) 7. 排除文法型詞彙,代詞、冠詞、連詞

8. 輸出詞頻最大TOP20,把結果存放到檔案裡

xu=list(stayed_line.items())

xu.sort(key=lambda x:x[1],reverse=True) import pandas as pd

pd.DataFrame(data=xu).to_csv("D:\\最強全才.csv",encoding='utf-8') 9. 生成詞雲。

具體代碼:

# -*- coding: utf-8 -*-

import jieba

#加載停用表

stop = open("D:\\stops.txt", "r",encoding='utf-8').read()

#加載字典檔案

jieba.load_userdict("D:\\dict.txt")

#分解詞語

stopwords = []

for word in stop:

stopwords.append(word.strip())

article = open("D:\\最強全才.txt", "r",encoding='utf-8').read()

words = jieba.cut(article, cut_all = False)

#統計詞頻

stayed_line = {}

for word in words:

if word.encode("utf-8") not in stopwords:

if len(word)==1:

continue

else:

stayed_line[word]=stayed_line.get(word,0)+1

print (stayed_line)

#排序

xu=list(stayed_line.items())

xu.sort(key=lambda x:x[1],reverse=True)

#輸出前20個結果

for i in range(20):

print(xu[i])

#存到csv檔案中

import pandas as pd

pd.DataFrame(data=xu).to_csv("D:\\最強全才.csv",encoding='utf-8')

#詞雲

from wordcloud import WordCloud

import matplotlib.pyplot as plt

wl_split=' '.join(xu)

mywc = WordCloud().generate(words)

plt.imshow(mywc)

plt.axis("off")

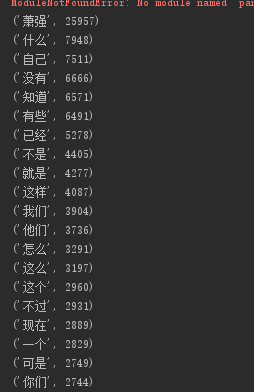

plt.show() 前20的結果:

詞雲圖: