本質:在對輸入做9--->1的映射關系時,保持了輸出相對于input中的位置性關系

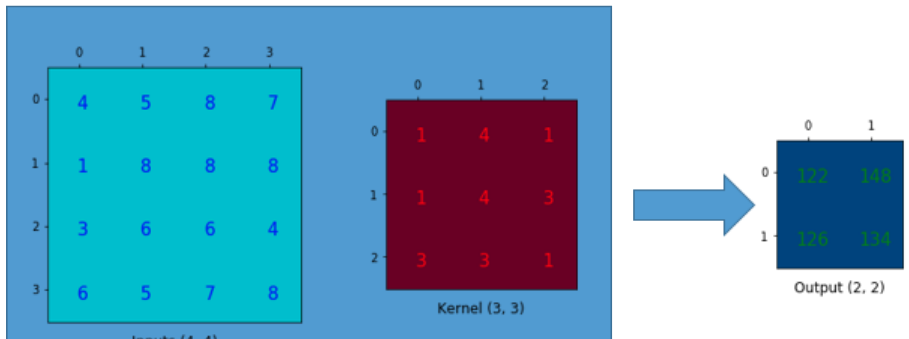

對核矩陣做以下變形:卷積核的滑動步驟變成了卷積核矩陣的擴增

卷積的矩陣乘法變成以下形式:核矩陣重排,輸入featuremap變形為向量

deconvlution/transpose-convlution

動機

想要網絡去學出一種最優的上采樣方法,而不是像基于插值似的手動方法,它有可以學習的參數.

缺點:反卷積會在生成的圖像中造成棋盤效應(checkerboard artifacts),推薦在使用轉置卷積進行上采樣操作之後再過一個普通的卷積來減輕此類問題.

動機:

上采樣及池化過程中存在緻命的問題:

内部資料結構丢失,空間層級化資訊丢失

小物體無法重建

希望:既可以保留内部資料結構又可以避免使用下采樣這樣的方式

定義:在标準卷積的Convolution map的基礎上注入空洞,以此來增加感受野(reception field)。

是以,Dilated Convolution在Standard Convolution的基礎上又多了一個超參數(hyper-parameter)稱之為膨脹率(dilation rate)

問題:

kernel并不連續,造成資訊提取的不連續

旨在提取大範圍資訊,對小目标有弊。是以如何同時處理大小目标的關系,就成了膨脹卷積設計的關鍵。

具體實作: 膨脹後的卷積核的大小: (0)所謂的空洞就是填充0

改進:HDC--混合膨脹卷積

疊加的膨脹卷積的膨脹率dilated rate不能有大于1的公約數(比如[2, 4, 6]),不然會産生栅格效應

将輸入通道分組,然後分别卷積.分兩組,計算量就減半.