Python----資料分析-使用scikit-learn構模組化型實訓(wine資料集、wine_quality資料)

目錄:

實訓1 使用 sklearn處理wine和wine_quality資料集

實訓2 建構基于wine資料集的k- Means聚類模型

實訓3 建構基于wine資料集的SVM分類模型

實訓4 建構基于wine_quality資料集的回歸模型

wine資料集包含來自3種不同起源的葡萄酒的共178條記錄。13個屬性是葡萄酒的13種化學成分。通過化學分析可以來推斷葡萄酒的起源。值得一提的是所有屬性變量都是連續變量。

實訓1 使用 sklearn處理wine和wine_quality資料集

1.訓練要點2.需求說明

- 掌握 sklearn轉換器的用法。

- 掌握訓練集、測試集劃分的方法。

- 掌握使用sklearn進行PCA降維的方法。

3.實作思路及步驟

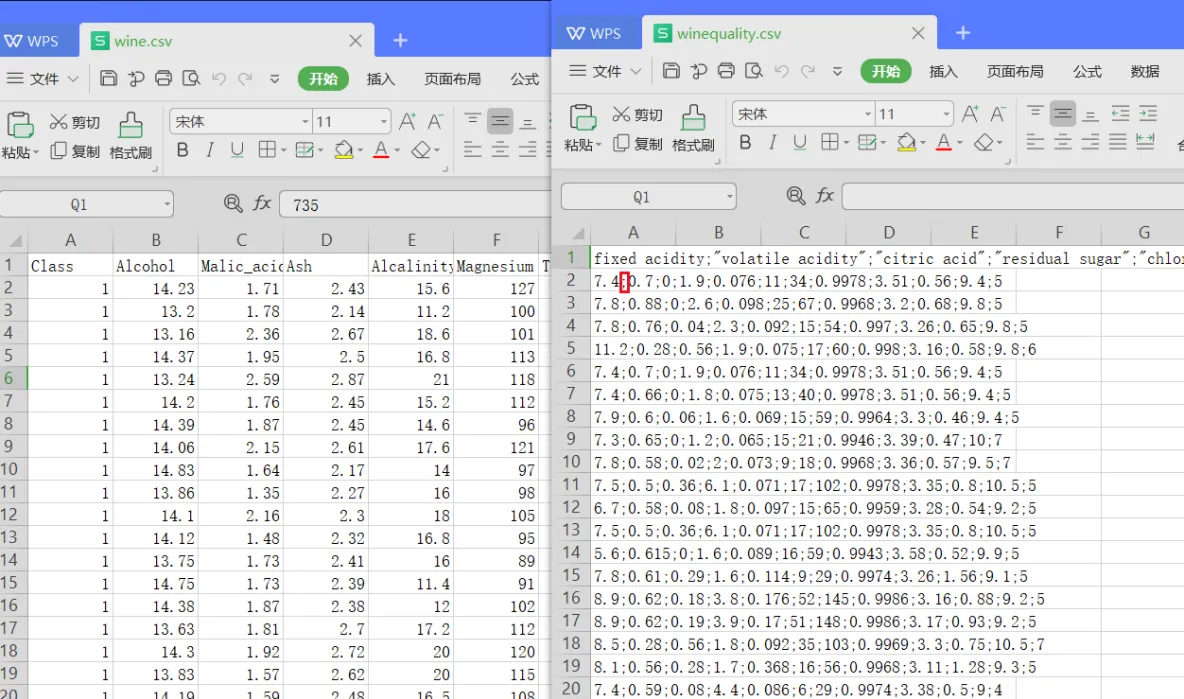

- wine資料集和 winequality資料集是兩份和酒有關的資料集。wine資料集包含3種 同起源的葡萄酒的記錄,共178條。其中,每個特征對應葡萄酒的每種化學成分,并且都 屬于連續型資料。通過化學分析可以推斷葡萄酒的起源。

winequality資料集共有4898個觀察值,11個輸入特征和一個标簽。其中,不同類的

觀察值數量不等,所有特征為連續型資料。通過酒的各類化學成分,預測該葡萄酒的評分

- 使用pandas庫分别讀取wine資料集和 winquality資料集

- 将wine資料集和winequality資料集的資料和标簽拆分開(提取)。

- 将winequality資料集劃分為訓練集和測試集。

- 标準化wine資料集和 wine quality資料集

- 對wine資料集和 winequality資料集進行PCA降維。

import pandas as pd

// 讀取資料

wine_quality = pd.read_csv('data/winequality.csv',sep=';')

wine = pd.read_csv('data/wine.csv')

print(type(wine),type(wine_quality))

//<class 'pandas.core.frame.DataFrame'> <class 'pandas.core.frame.DataFrame'>

// 提取 wine_quality 資料

wine_quality_data = wine_quality.iloc[:,:-1]

wine_quality_target = wine_quality['quality']

// 提取 wine 資料

wine_data = wine.iloc[:,:-1]

wine_target = wine['Class'] wine資料集和winequality資料集的表現形式不一樣,這裡的wine資料集可以直接讀入,而winequality資料集在檔案中是以”;”為間隔的,是以要采用間隔讀入的方式擷取其資料。讀取後資料都以DataFrame的類型保留,使用iloc等切片操作提取所需資料。

// 将 wine_quality 資料劃分為訓練集和測試集

from sklearn.model_selection import train_test_split

wine_quality_data_train,wine_quality_data_test,\

wine_quality_target_train,wine_quality_target_test=\

train_test_split(wine_quality_data,wine_quality_target,test_size=0.2,random_state=321)

wine_data_train,wine_data_test,\

wine_target_train,wine_target_test=\

train_test_split(wine_data,wine_target,test_size=0.2,random_state=321) train_test_split()函數将資料集劃分為訓練集和測試集兩部分,參數test_size=0.2代表着測試集在總數中的占比,通過計算wine_data總共178條記錄,wine_data_test有36條,占0.20224171(20%),參數random_state=321,表示随機種子編号,友善測試時得到相同随機結果。

// 标準化資料集

from sklearn.preprocessing import StandardScaler

stdScaler = StandardScaler().fit(wine_data_train) // 生成标準化規則

wine_trainScaler = stdScaler.transform(wine_data_train) // 對訓練集标準化

wine_testScaler = stdScaler.transform(wine_data_test) // 用訓練集建立的模型對測試集标準化

Scaler = StandardScaler().fit(wine_quality_data_train) // 生成标準化規則

winequality_trainScaler = Scaler.transform(wine_quality_data_train) // 對訓練集标準化

winequality_testScaler = Scaler.transform(wine_quality_data_test) // 用訓練集建立的模型對測試集标準化 這裡有個順序:生成标準化規則;對訓練集标準化;用訓練集建立的模型對測試集标準化

主要是因為在資料分析的時候,各類特征處理相關的操作都需要對訓練集和測試集分開進行,同時需要将訓練集的操作規則、權重系數等應用到測試集中。這也就是為什麼生成規則時fit傳入訓練集。transform函數緊接着将定義好的規則應用對傳入的特征進行對應轉換。

// PCA降維

from sklearn.decomposition import PCA

pca_model = PCA(n_components=5).fit(wine_trainScaler) // 生成PCA規則

wine_trainpca = pca_model.transform(wine_trainScaler) // 将規則應用到訓練集

wine_testpca = pca_model.transform(wine_testScaler) // 将規則應用到測試集

pca_model = PCA(n_components=5).fit(winequality_trainScaler) // 生成PCA規則

winequality_trainpca = pca_model.transform(winequality_trainScaler) // 将規則應用到訓練集

winequality_testpca = pca_model.transform(winequality_testScaler) #// 将規則應用到測試集 PCA(n_components=5)的參數n_components表示将原始資料降低到n個次元。

傳回頂部

實訓2 建構基于wine資料集的k- Means聚類模型

1.訓練要點2.需求說明

- 了解sklearn估計器的用法。

- 掌握聚類模型的建構方法。

- 掌握聚類模型的評價方法。

3.實作思路及步驟

- wine資料集的葡萄酒總共分為3種,通過将wine資料集的資料進行聚類,聚集為3 個簇,能夠實作葡萄酒的類别劃分。

- 根據實訓1的wine資料集處理的結果,建構聚類數目為3的- -Means模型。

- 對比真實标簽和聚類标簽求取FMI。

- 在聚類數目為2~10類時,确定最優聚類數目。

- 求取模型的輪廓系數,繪制輪廓系數折線圖,确定最優聚類數目。

- 求取 Calinski-Harabasz-指數,确定最優聚類數目。

// 建構 K-Means 模型

from sklearn.cluster import KMeans

kmeans = KMeans(n_clusters=3,random_state=32).fit(wine_trainScaler) //建構訓練模型

print('wine_trainScaler建構的模型為:\n',kmeans)

//wine_trainScaler建構的模型為:

KMeans(algorithm='auto', copy_x=True, init='k-means++', max_iter=300,

n_clusters=3, n_init=10, n_jobs=None, precompute_distances='auto',

random_state=32, tol=0.0001, verbose=0) 建構K-Means聚類模型,參數n_clusters=3表示要形成的團簇數目,也就是分為幾類,這裡是分為3類。

// 對比真實标簽和聚類标簽求取FMI

from sklearn.metrics import fowlkes_mallows_score //FMI評價法

score=fowlkes_mallows_score(wine_target_train,kmeans.labels_)

print("wine資料集的FMI:%f"%(score))

//wine資料集的FMI:0.901648

//在聚類數目為2~10類時,确定最優聚類數目

from sklearn.metrics import fowlkes_mallows_score

from sklearn.cluster import KMeans

for i in range(2,11):

kmeans = KMeans(n_clusters=i,random_state=32).fit(wine_trainScaler)

score = fowlkes_mallows_score(wine_target_train,kmeans.labels_)

print('wine聚%d類FMI評價分為:%f'%(i,score))

wine聚2類FMI評價分為:0.693972

wine聚3類FMI評價分為:0.901648

wine聚4類FMI評價分為:0.801280

wine聚5類FMI評價分為:0.775956

wine聚6類FMI評價分為:0.782225

wine聚7類FMI評價分為:0.607152

wine聚8類FMI評價分為:0.570184

wine聚9類FMI評價分為:0.567783

wine聚10類FMI評價分為:0.559720 // 求取模型的輪廓系數,繪制輪廓系數折線圖,确定最優聚類數目

from sklearn.metrics import silhouette_score

import matplotlib.pyplot as plt

silhouettteScore = []

for i in range(2,11):

// 建構并訓練模型

kmeans = KMeans(n_clusters = i,random_state=1).fit(wine)

score = silhouette_score(wine,kmeans.labels_)

silhouettteScore.append(score)

plt.figure(figsize=(10,6))

plt.plot(range(2,11),silhouettteScore,linewidth=1.5, linestyle="-")

plt.show() 求取模型的輪廓系數:

//求取 Calinski-Harabasz指數,确定最優聚類數

from sklearn.metrics import calinski_harabasz_score

for i in range(2,11):

// 建構并訓練模型

kmeans = KMeans(n_clusters = i,random_state=1).fit(wine_trainScaler)

score = calinski_harabaz_score(wine_trainScaler,kmeans.labels_)

print('seeds資料聚%d類calinski_harabaz指數為:%f'%(i,score))

seeds資料聚2類calinski_harabaz指數為:67.189882

seeds資料聚3類calinski_harabaz指數為:62.785275

seeds資料聚4類calinski_harabaz指數為:49.058796

seeds資料聚5類calinski_harabaz指數為:41.101132

seeds資料聚6類calinski_harabaz指數為:36.321948

seeds資料聚7類calinski_harabaz指數為:34.295581

seeds資料聚8類calinski_harabaz指數為:31.101151

seeds資料聚9類calinski_harabaz指數為:28.693663

seeds資料聚10類calinski_harabaz指數為:28.563627 分析FMI評價分值,可以看出wine資料分3類的時候其FMI值最高,故聚類為3類的時候wine資料集K-means聚類效果最好

分析輪廓系數折線圖,可以看出在wine資料集為3的時候,其平均畸變程度最大,故亦可知聚類為3類的時候效果最佳

傳回頂部

實訓3 建構基于wine資料集的SVM分類模型

1.訓練要點2.需求說明

- 掌握sklearn估計器的用法。

- 掌握分類模型的建構方法。

- 掌握分類模型的評價方法。

3.實作思路及步驟

- wine資料集中的葡萄酒類别為3種,将wie資料集劃分為訓練集和測試集,使用訓練 集訓練SVM分類模型,并使用訓練完成的模型預測測試集的葡萄酒類别歸屬。

- 讀取wine資料集,區分标簽和資料。

- 将wine資料集劃分為訓練集和測試集

- 使用離差标準化方法标準化wine資料集。

- 建構SVM模型,并預測測試集結果。

- 列印出分類報告,評價分類模型性能。

import pandas as pd

// 讀取資料

wine_quality = pd.read_csv('data/winequality.csv',sep=';')

wine = pd.read_csv('data/wine.csv')

// 提取 wine_quality 資料

wine_quality_data = wine_quality.iloc[:,:-1]

wine_quality_target = wine_quality['quality']

// 提取 wine 資料

wine_data = wine.iloc[:,:-1]

wine_target = wine['Class']

from sklearn.model_selection import train_test_split

from sklearn.svm import SVC

from sklearn.preprocessing import MinMaxScaler

// 劃分訓練集、測試集

wine_data_train,wine_data_test,wine_target_train,wine_target_test=\

train_test_split(wine_data,wine_target,test_size=0.2,random_state=123)

// 資料标準化規則

Scaler = MinMaxScaler().fit(wine_data_train)

// 應用規則

wine_trainScaler = Scaler.transform(wine_data_train) // 對訓練集進行标準化

wine_testScaler = Scaler.transform(wine_data_test) // 用訓練集訓練的模型對測試集标準化

// 建構SVM分類模型

svm = SVC().fit(wine_trainScaler,wine_target_train)

print("建立的SVM模型為:\n",svm)

//建立的SVM模型為:

SVC(C=1.0, break_ties=False, cache_size=200, class_weight=None, coef0=0.0,

decision_function_shape='ovr', degree=3, gamma='scale', kernel='rbf',

max_iter=-1, probability=False, random_state=None, shrinking=True,

tol=0.001, verbose=False)

// 預測訓練結果

wine_target_pred = svm.predict(wine_testScaler)

print('預測前20個結果為:',wine_target_pred[:20])

//預測前20個結果為: [3 2 3 2 2 3 1 3 3 2 3 3 3 1 1 3 2 2 1 2] // 列印模型評價報告

from sklearn.metrics import classification_report

print('使用SVM預測資料的分析報告為:\n',classification_report(wine_target_test,wine_target_pred))

//使用SVM預測資料的分析報告為:

precision recall f1-score support

1 1.00 1.00 1.00 8

2 1.00 1.00 1.00 11

3 1.00 1.00 1.00 17

accuracy 1.00 36

macro avg 1.00 1.00 1.00 36

weighted avg 1.00 1.00 1.00 36 傳回頂部

實訓4 建構基于wine_quality資料集的回歸模型

1.訓練要點

(1)熟練sklearn估計器的用法。

(2)掌握回歸模型的建構方法。

(3)掌握回歸模型的評價方法。

2.需求說明

3.實作思路及步驟

- winequality資料集的葡萄酒評分在1~10之間,建線性回歸模型與梯度提升回歸模 型,訓練 winequality資料集的訓練集資料,訓練完成後預測測試集的葡萄酒評分。結合 真實評分,評價建構的兩個回歸模型的好壞。

- 根據winequality資料集處理的結果,建構線性回歸模型。

- 根據wine quality資料集處理的結果,建構梯度提升回歸模型。

- 結合真實評分和預測評分,計算均方誤差中值絕對誤差、可解釋方內插補點。

- 根據得分,判定模型的性能優劣。

// 建構線性回歸模型

from sklearn.linear_model import LinearRegression

clf = LinearRegression().fit(winequality_trainpca,wine_quality_target_train)

y_pred = clf.predict(winequality_testpca)

print('線性回歸模型預測前10個結果為:','\n',y_pred[:10])

線性回歸模型預測前10個結果為:

[5.27204611 5.16410891 6.93394979 6.52520955 5.56143289 5.02815869

5.17867439 5.95768188 5.68991275 5.33085457] // 根據wine_quality資料集處理的結果,建構梯度提升回歸模型。

from sklearn.ensemble import GradientBoostingRegressor

gbr_wine = GradientBoostingRegressor().fit(winequality_trainpca,wine_quality_target_train)

wine_target_pred = gbr_wine.predict(winequality_testpca)

print('梯度提升回歸模型預測前10個結果為:','\n',wine_target_pred[:10])

print('真實标簽前10個預測結果為:','\n',list(wine_quality_target_test[:10]))

梯度提升回歸模型預測前10個結果為:

[5.4569842 5.1020336 6.39325331 6.55163291 5.62504565 5.16770619

5.22503393 5.6942301 5.43575267 5.22052962]

真實标簽前10個預測結果為:

[6, 5, 6, 7, 6, 6, 5, 6, 6, 5] from sklearn.metrics import mean_absolute_error,mean_squared_error,median_absolute_error,explained_variance_score,r2_score

print('線性回歸模型評價結果:')

print('winequality資料線性回歸模型的平均絕對誤差為:',

mean_absolute_error(wine_quality_target_test,y_pred))

print('winequality資料線性回歸模型的均方誤差為:',

mean_squared_error(wine_quality_target_test,y_pred))

print('winequality資料線性回歸模型的中值絕對誤差為:',

median_absolute_error(wine_quality_target_test,y_pred))

print('winequality資料線性回歸模型的可解釋方內插補點為:',

explained_variance_score(wine_quality_target_test,y_pred))

print('winequality資料線性回歸模型的R方值為:',

r2_score(wine_quality_target_test,y_pred))

線性回歸模型評價結果:

winequality資料線性回歸模型的平均絕對誤差為: 0.500442590483755

winequality資料線性回歸模型的均方誤差為: 0.4116335179704622

winequality資料線性回歸模型的中值絕對誤差為: 0.42681355355182804

winequality資料線性回歸模型的可解釋方內插補點為: 0.3304259967770349

winequality資料線性回歸模型的R方值為: 0.32853409414296564

print('梯度提升回歸模型評價結果:')

print('winequality資料梯度提升回歸樹模型的平均絕對誤差為:',

mean_absolute_error(wine_quality_target_test,wine_target_pred))

print('winequality資料梯度提升回歸樹模型的均方誤差為:',

mean_squared_error(wine_quality_target_test,wine_target_pred))

print('winequality資料梯度提升回歸樹模型的中值絕對誤差為:',

median_absolute_error(wine_quality_target_test,wine_target_pred))

print('winequality資料梯度提升回歸樹模型的可解釋方內插補點為:',

explained_variance_score(wine_quality_target_test,wine_target_pred))

print('winequality資料梯度提升回歸樹模型的R方值為:',

r2_score(wine_quality_target_test,wine_target_pred))

梯度提升回歸模型評價結果:

winequality資料梯度提升回歸樹模型的平均絕對誤差為: 0.49135412186249

winequality資料梯度提升回歸樹模型的均方誤差為: 0.3929327053069297

winequality資料梯度提升回歸樹模型的中值絕對誤差為: 0.4130905910176561

winequality資料梯度提升回歸樹模型的可解釋方內插補點為: 0.3620462459660544

winequality資料梯度提升回歸樹模型的R方值為: 0.3590392827808905