卷積神經網絡

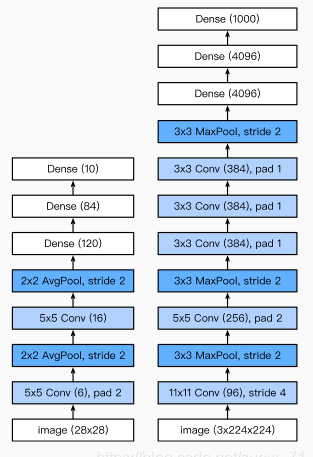

AlexNet

首次證明了學習到的特征可以超越⼿⼯設計的特征,進而⼀舉打破計算機視覺研究的前狀。

特征:

- 8層變換,其中有5層卷積和2層全連接配接隐藏層,以及1個全連接配接輸出層。

- 将sigmoid激活函數改成了更加簡單的ReLU激活函數。

- 用Dropout來控制全連接配接層的模型複雜度。

- 引入資料增強,如翻轉、裁剪和顔色變化,進而進一步擴大資料集來緩解過拟合。

使用重複元素的網絡(VGG)

VGG:通過重複使⽤簡單的基礎塊來建構深度模型。

Block:數個相同的填充為1、視窗形狀為3×3的卷積層,接上一個步幅為2、視窗形狀為2×2的最大池化層。

卷積層保持輸入的高和寬不變,而池化層則對其減半。

⽹絡中的⽹絡(NiN)

LeNet、AlexNet和VGG:先以由卷積層構成的子產品充分抽取 空間特征,再以由全連接配接層構成的子產品來輸出分類結果。

NiN:串聯多個由卷積層和“全連接配接”層構成的小⽹絡來建構⼀個深層⽹絡。

⽤了輸出通道數等于标簽類别數的NiN塊,然後使⽤全局平均池化層對每個通道中所有元素求平均并直接⽤于分類。

-

1×1卷積核作用

1.放縮通道數:通過控制卷積核的數量達到通道數的放縮。

2.增加非線性。1×1卷積核的卷積過程相當于全連接配接層的計算過程,并且還加入了非線性激活函數,進而可以增加網絡的非線性。

3.計算參數少

GoogLeNet

- 由Inception基礎塊組成。

- Inception塊相當于⼀個有4條線路的⼦⽹絡。它通過不同視窗形狀的卷積層和最⼤池化層來并⾏抽取資訊,并使⽤1×1卷積層減少通道數進而降低模型複雜度。

- 可以⾃定義的超參數是每個層的輸出通道數,我們以此來控制模型複雜度。

Python中的*(星号)和**(雙星号)完全詳解

https://blog.csdn.net/zkk9527/article/details/88675129