所謂AR(Augmented Reality,增強現實)廣義上來說就是在現實環境上疊加虛拟場景,差別于VR,了解真實環境是AR的基本點。基于平面圖的視覺跟蹤是AR的核心技術之一,據了解,盡管目前AR發展迅速,但是計算機視覺算法在處理平面跟蹤時依然還有很多不足,在平面圖檔傾斜、陰影、遮擋、運動狀态下,AR的識别跟蹤還不穩定。

國内AR公司亮風台研發出基于圖的平面物體跟蹤算法,該可在強幹擾的場景下實作快速且準确的平面跟蹤。其成果論文已被人工智能領域國際頂級期刊《PAMI》(IEEE模式分析和機器智能彙刊)錄用,即将于2018年正式刊出。

該論文主要實作了:

- 提出将圖模型和圖比對機制運用于平面物體跟蹤。

- 設計了一種能預測物體姿态和關鍵點比對的新政策,并把這種政策內建到最優解尋找的問題中。

- 設計了一個帶有标注的真實場景資料庫,這個資料庫可以用來評估快速移動下的視覺跟蹤。

作者介紹

淩海濱,亮風台首席科學家,Temple大學終身教授,曾就職于微軟亞洲研究院、西門子美國研究院。在T-PAMI、IJCV、T-IP、CVPR、ICCV、ECCV、AAAI、MICCAI等AI相關領域國際權威雜志和頂級會議上發表論文140餘篇,曾任權威會議Area Chair、IEEE PAMI 編委,也是美國NSF Career Award獲得者。

王濤,北京交通大學碩博,主持和參與包括國家自然科學基金項目在内的科研項目20餘項。以第一作者在AAAI、CVIU等國際學術會議和期刊發表論文10餘篇。目前主要研究方向為基于圖模型的圖像語義了解和計算。

下文内容由亮風台編譯自論文原文,雷鋒網經授權選編。

基于圖的跟蹤算法:Gracker

基于圖的跟蹤算法Gracker能夠充分利用物體的結構資訊來提高跟蹤性能。為了表示物體的結構,我們将平面物體模組化為一個圖而不是簡單的關鍵點集合。如此,将跟蹤問題轉化為圖比對問題,利用幾何圖比對算法建立關鍵點的對應關系。

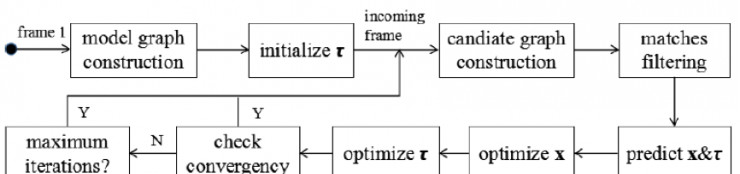

Gracker算法的架構

具體地說,我們用圖對平面物體模組化,圖的頂點由可靠的自動選擇機制生成而不是傳統的基于HoG的檢測子。這種機制使得圖結構更加穩定,是以本方法對極端環境變量具有魯棒性,例如極端照度條件和運動模糊。

除此之外,我們把特征對應和姿态估計內建在一個統一的幾何圖比對架構中。幾何圖中的二進制限制條件能夠對全局幾何關系編碼,這樣Gracker算法對各種幾何和光學變換更具有魯棒性和精确性。

如何構造圖

将目标表示為無向圖,而不是一堆局部部件或者星形模型。給定目标圖GM和候選圖GC,我們的目标是找到他們之間的最優對應關系,然後根據對應結果決定最優的目标狀态。可以按如下方式構造目标物體的模型圖:

1. 生成頂點:我們提取每一幀的關鍵點來表示局部部分,然後模組化為圖的頂點。經典算法是通過搜尋不同縮放尺寸的DoG圖像的局部最小/最大值來獲得關鍵點,比如SIFT。然而關鍵點的數量會随着檢測子和幀背景的變化而變化。另外,SIFT容易受到不同環境變化影響,例如:照度變化和運動模糊,這不利于跟蹤精度。我們采用更魯棒的方法提取關鍵點:首先對每個像素R計算SIFT響應,随後我們将R等分為N個網格,從每個網格中取最大的SIFT響應作為這個網格的關鍵點,将所選取的關鍵點模組化為圖的節點,然後計算它們的描述子作為這個節點的屬性。

2. 生成邊:現存幾種普遍的邊生存方法,比如鄰域圖,K最近鄰圖和全連通圖。全連通圖包含了大量的結構資訊,但是它占用太多存儲空間和計算時間,是以并不适用于實時應用。鄰域圖依賴于參數的選取,而且受到物體縮放問題的影響。我們使用狄洛尼三角剖分建構圖的邊,因為它具有平移、縮放和旋轉不變性。

對每一個輸入幀,我們用同樣方式構造一個候選圖Gt,然後将比對問題表達為圖比對問題。

圖比對

給定規模為N的模型圖和候選圖,比對問題可以視為尋找GM和Gt頂點的對應關系。一般的圖比對問題中,兩個頂點集間的變換通常不被考慮,因為缺乏先驗知識。而對于物體跟蹤,我們可以利用先前幀的變換資訊引導比對。我們提出了一種幾何圖比對(GGM)架構将變換線索融入圖比對。傳統的基于比對的跟蹤方法将特征比對和變換估計區分計算,GMM方法的不同在于将特征比對和變換估計結合成一個統一的架構。

Gracker算法效果

為了系統地評估算法,我們采用了兩個常用的基準資料庫,UCSB[1]和TMT[2],和一個我們收集的快速運動資料庫。下面我們比較了Gracker和其他三個基準算法Struck[3], IC[4], ESM[5]在兩個基準資料庫和我們收集的資料庫上的結果。

縮放:下圖是弱紋理的落日圖檔。可以看到IC和Struck算法出現目标丢失情況,而ESM和Gracker算法給出更精确的結果。

傾斜:下圖書本傾斜的例子揭示了IC,ESM和Gracker算法對傾斜具有魯棒性,而當物體處于極端傾斜的情況下,Struck算法未能捕捉到對象物體。

平移和旋轉:所有的算法都能處理小角度旋轉,但是大角度情況下,隻有ESM和Gracker比較魯棒。在360幀之後由于運動模糊,ESM算法變得不精确,而Gracker算法在所有幀中更穩定。

遮擋和光線:下圖給出了幾種算法在正常和黑暗的光照條件下的部分遮擋的實驗結果。基于模闆的算法如IC和ESM受到部分遮擋的影響。相反,基于比對的算法Struck和Gracker對部分遮擋更魯棒。在黑暗光照條件下,Struck算法精度相對較低,因為其使用的基于HoG的檢測子在黑暗光照條件下檢測到的關鍵點不可靠。而我們提出的Gracker算法在光線變化的情況下更魯棒。

運動模糊:IC和Struck算法對運動模糊很敏感,是以從很早開始直到視訊結束都丢失了目标。ESM算法基本上在每一幀裡面都捕捉到了對象物體,但是捕捉到的位置并不準确。相反,我們提出的Gracker在所有的幀裡都給出了更加準确的結果。

複合運動變換:下圖顯示了集平移,旋轉,傾斜和輕微的非線性變換的複合變換。從比較中我們可以看到,我們的Gracker算法給出了最好的跟蹤結果。

部分參考文獻:

[1] S. Gauglitz, T. Hollerer, and M. Turk. Evaluation of interest point detectors and feature descriptors for visual tracking. IJCV, 94(3):335– 360, 2011.

[2] A. Roy, X. Zhang, N. Wolleb, C. P. Quintero, and M. J¨agersand. Tracking benchmark and evaluation for manipulation tasks. In ICRA, pages 2448– 2453, 2015.

[3] S. Hare, A. Saffari, and P. H. S. Torr. Efficient online structured output learning for keypoing-based object tracking. In CVPR, pages 1894–1901, 2012.

[4] S. Baker and lain A. Matthews. Lucas-kanade 20 years on: A unifying framework. IJCV, 56(3):221–255, 2004.

[5] E. Malis. Improving vision-based control using efficient second-order minimization techniques. In ICRA, pages 1843–1848, 2004.