概述

1)資料查詢(官方網址)

(1)官方網站:

http://hadoop.apache.org/

(2)各個版本歸檔庫位址

https://archive.apache.org/dist/hadoop/common/hadoop-2.7.7/

(3)hadoop2.7.6版本詳情介紹

https://hadoop.apache.org/docs/r2.7.6/

2)Hadoop運作模式

(1)本地模式(預設模式):

不需要啟用單獨程序,直接可以運作,測試和開發時使用。

(2)僞分布式模式:

等同于完全分布式,隻有一個節點。

(3)完全分布式模式:

多個節點一起運作。

1. 本地檔案運作Hadoop 示例

1.1 運作官方grep案例

1)建立在hadoop-2.7.7檔案下面建立一個input檔案夾

2)将hadoop的xml配置檔案複制到input

3)執行share目錄下的mapreduce程式

4)檢視輸出結果

代碼示例:

[shaofei@hadoop128 hadoop-2.7.7]$ mkdir input

[shaofei@hadoop128 hadoop-2.7.7]$ cp -r etc/hadoop/*.xml input/

[shaofei@hadoop128 hadoop-2.7.7]$ ll input/

[shaofei@hadoop128 hadoop-2.7.7]$ hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.7.jar grep input/ output 'dfs[a-z.]+'

[shaofei@hadoop128 hadoop-2.7.7]$ cat output/*

1.2 官方wordcount案例

1)建立在hadoop-2.7.7檔案下面建立一個wcinput檔案夾

2)在wcinput檔案下建立一個wc.input檔案

3)編輯wc.input檔案

4)回到hadoop目錄/opt/module/hadoop-2.7.7

5)執行程式:

6)檢視結果:

代碼示例:

[shaofei@hadoop128 hadoop-2.7.7]$ mkdir wcinput

[shaofei@hadoop128 hadoop-2.7.7]$ vim wcinput/input.input

java

java

java

hadoop

hadoop

python

pyfysf

upuptop

java

lll

haha

helloworld

:wq

[shaofei@hadoop128 hadoop-2.7.7]$ hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.7.jar wordcount wcinput/ wcoutput

[shaofei@hadoop128 hadoop-2.7.7]$ cat wcoutput/*

hadoop 2

haha 1

helloworld 1

java 4

lll 1

pyfysf 1

python 1

upuptop 1

2 僞分布式運作Hadoop 案例

2.1 啟動HDFS并運作MapReduce 程式

1)執行步驟

(1)配置叢集

(a)配置:hadoop-env.sh

Linux系統中擷取jdk的安裝路徑:

修改JAVA_HOME 路徑:

(b)配置:core-site.xml

(c)配置:hdfs-site.xml

(2)啟動叢集

(a)格式化namenode(第一次啟動時格式化,以後就不要總格式化)

(b)啟動namenode

(c)啟動datanode

(3)檢視叢集

(a)檢視是否啟動成功

(b)檢視産生的log日志

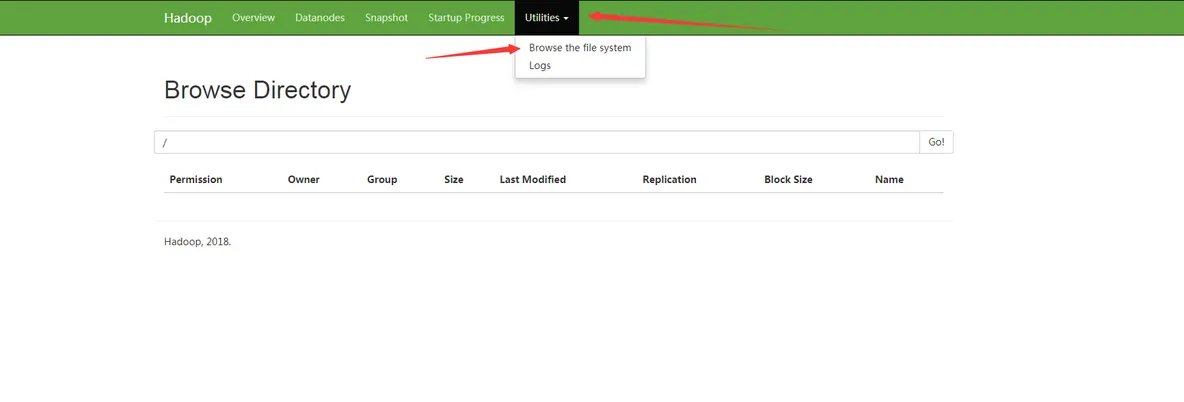

(c)web端檢視HDFS檔案系統

(4)操作叢集

(a)在hdfs檔案系統上建立一個input檔案夾

(b)将測試檔案内容上傳到檔案系統上

(c)檢視上傳的檔案是否正确

(d)運作mapreduce程式

(e)檢視輸出結果

指令行檢視:

浏覽器檢視

浏覽器檢視.png

(f)将測試檔案内容下載下傳到本地

(g)删除輸出結果

代碼示例

1)配置叢集

配置hadoop-env 裡面的JAVA_HOME

[shaofei@hadoop128 hadoop-2.7.7]$ vim etc/hadoop/hadoop-env.sh

# The java implementation to use.

export JAVA_HOME=/opt/module/jdk1.8.0_191

配置core-site.xml

[shaofei@hadoop128 hadoop-2.7.7]$ vim etc/hadoop/core-site.xml

<configuration>

<!-- 指定HDFS中NameNode的位址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop128:9000</value>

</property>

<!-- 指定hadoop運作時産生檔案的存儲目錄 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/module/hadoop-2.7.7/data/tmp</value>

</property>

</configuration>

配置hdfs-site.xml

[shaofei@hadoop128 hadoop-2.7.7]$ vim etc/hadoop/hdfs-site.xml

<configuration>

<!-- 指定HDFS副本的數量 -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

2)啟動叢集

格式化namenode

[shaofei@hadoop128 hadoop-2.7.7]$ bin/hdfs namenode -format

啟動namenode

[shaofei@hadoop128 hadoop-2.7.7]$ sbin/hadoop-daemon.sh start namenode

确認是否開啟成功

[shaofei@hadoop128 hadoop-2.7.7]$ jps

2323 NameNode

2392 Jps

啟動datanode

[shaofei@hadoop128 hadoop-2.7.7]$ sbin/hadoop-daemon.sh start datanode

确認是否開啟成功

[shaofei@hadoop128 hadoop-2.7.7]$ jps

2417 DataNode

2323 NameNode

2492 Jps

3)檢視叢集

檢視生成的日志log

[shaofei@hadoop128 hadoop-2.7.7]$ cat logs/hadoop-shaofei-datanode-hadoop128.log

在web端檢視HDFS檔案系統[ip 為linux伺服器ip]

http://hadoop128:50070

http://ip:50070

http://hadoop128:50070/explorer.html#/

4)操作叢集

在hdfs檔案系統上建立一個wcinput檔案夾

[shaofei@hadoop128 hadoop-2.7.7]$ bin/hdfs dfs -mkdir -p /user/shaofei/wcinput

檢視是否建立成功

[shaofei@hadoop128 hadoop-2.7.7]$ bin/hdfs dfs -ls /user

複制本地的 wcinput/input.input 到 hdfs系統中的wcinput中 并檢視是否上傳成功

[shaofei@hadoop128 hadoop-2.7.7]$ bin/hdfs dfs -put wcinput/input.input /user/shaofei/wcinput

[shaofei@hadoop128 hadoop-2.7.7]$ bin/hdfs dfs -ls /user/shaofei/wcinput

執行MapReduce程式

[shaofei@hadoop128 hadoop-2.7.7]$ hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.7.jar wordcount /user/shaofei/wcinput/ /user/shaofei/wcoutput

将結果下載下傳到本地檢視

[shaofei@hadoop128 hadoop-2.7.7]$ bin/hdfs dfs -get /user/shaofei/wcoutput

[shaofei@hadoop128 hadoop-2.7.7]$ cat wcoutput/*

在web中檢視hdfs系統

/user/shaofei

/user/shaofei/wcinput

/user/shaofei/wcoutput

2.2 YARN上運作MapReduce 程式

1)執行步驟

(1)配置叢集

(a)配置yarn-env.sh

配置一下JAVA_HOME

(b)配置yarn-site.xml

(c)配置:mapred-env.sh

配置一下JAVA_HOME

(d)配置: (對mapred-site.xml.template重新命名為) mapred-site.xml

(2)啟動叢集

(a)啟動前必須保證namenode和datanode已經啟動

(b)啟動resourcemanager

(c)啟動nodemanager

(3)叢集操作

(a)yarn的浏覽器頁面檢視

http://192.168.1.101:8088/cluster

(b)删除檔案系統上的output檔案

(c)執行mapreduce程式

(d)檢視運作結果

代碼示例

1)配置叢集

配置yarn-evn.sh中的JAVA_HOME

[shaofei@hadoop128 hadoop-2.7.7]$ vim etc/hadoop/yarn-env.sh

# some Java parameters

export JAVA_HOME=/opt/module/jdk1.8.0_191

配置yarn-site.xml

[shaofei@hadoop128 hadoop-2.7.7]$ vim etc/hadoop/yarn-site.xml

<configuration>

<!-- Site specific YARN configuration properties -->

<!-- reducer擷取資料的方式 -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 指定YARN的ResourceManager的位址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop128</value>

</property>

</configuration>

配置mapred-env.sh中的JAVA_HOME

[shaofei@hadoop128 hadoop-2.7.7]$ vim etc/hadoop/mapred-env.sh

export JAVA_HOME=/opt/module/jdk1.8.0_191

對mapred-site.xml.template 重命名

[shaofei@hadoop128 hadoop-2.7.7]$ mv etc/hadoop/mapred-site.xml.template etc/hadoop/mapred-site.xml

配置mapred-site.xml

[shaofei@hadoop128 hadoop-2.7.7]$ vim etc/hadoop/mapred-site.xml

<configuration>

<!-- 指定mr運作在yarn上 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

2)啟動叢集

啟動yarn之前需要确定namenode和datanode是啟動狀态

[shaofei@hadoop128 hadoop-2.7.7]$ jps

3184 Jps

2417 DataNode

2323 NameNode

啟動ResourceManager

[shaofei@hadoop128 hadoop-2.7.7]$ sbin/yarn-daemon.sh start resourcemanager

啟動NodeManager

[shaofei@hadoop128 hadoop-2.7.7]$ sbin/yarn-daemon.sh start nodemanager

檢視啟動程式清單

[shaofei@hadoop128 hadoop-2.7.7]$ jps

2417 DataNode

3217 ResourceManager

3587 Jps

2323 NameNode

3465 NodeManager

在浏覽器中檢視

http://[ip]:8088/cluster

2)執行MapReduce

删除檔案系統上的output檔案

[shaofei@hadoop128 hadoop-2.7.7]$ bin/hdfs dfs -rm -r /user/shaofei/wcoutput

執行mapreduce程式

hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.7.jar wordcount /user/shaofei/wcinput /user/shaofei/wcoutput

檢視運作結果

[shaofei@hadoop128 hadoop-2.7.7]$ hadoop fs -cat /user/shaofei/wcoutput/*

3 完全分布式

叢集部署規劃

| – | hadoop132 | hadoop133 | hadoop134 |

|---|---|---|---|

| HDFS | NameNode、DataNode | DataNode | SecondaryNameNode、DataNode |

| YARN | NodeManager | ResourceManager、NodeManager | NodeManager |

配置檔案

core-site.xml

<!-- 指定 HDFS 中 NameNode 的位址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop132:9000</value>

</property>

<!-- 指定 hadoop 運作時産生檔案的存儲目錄 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/module/hadoop-2.7.2/data/tmp</value>

</property>

hadoop-env.sh

export JAVA_HOME=/opt/module/jdk1.8.0_144

hdfs-site.xml

<configuration>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hadoop134:50090</value>

</property>

</configuration>

slaves

hadoop132

hadoop133

hadoop134

yarn

yarn-env.sh

export JAVA_HOME=/opt/module/jdk1.8.0_144

yarn-site.xml

<configuration>

<!-- reducer 擷取資料的方式 -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 指定 YARN 的 ResourceManager 的位址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop133</value>

</property>

</configuration>

mapreduce

mapred-env.sh

export JAVA_HOME=/opt/module/jdk1.8.0_144

mapred-site.xml

<configuration>

<!-- 指定 mr 運作在 yarn 上 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

叢集同步以上配置檔案

如果叢集是第一次啟動,需要格式化 namenode

$ bin/hdfs namenode -format

$ sbin/start-dfs.sh

第二台機器上啟動yarn

$ sbin/start-yarn.sh