微調(fine tuning)

首先舉一個例子,假設我們想從圖像中識别出不同種類的椅子,然後将購買連結推薦給使用者。一種可能的方法是先找出100種常見的椅子,為每種椅子拍攝1,000張不同角度的圖像,然後在收集到的圖像資料集上訓練一個分類模型。這個椅子資料集雖然可能比Fashion-MNIST資料集要龐大,但樣本數仍然不及ImageNet資料集中樣本數的十分之一。這可能會導緻适用于ImageNet資料集的複雜模型在這個椅子資料集上過拟合。同時,因為資料量有限,最終訓練得到的模型的精度也可能達不到實用的要求。

為了應對上述問題,一個顯而易見的解決辦法是收集更多的資料。然而,收集和标注資料會花費大量的時間和資金。例如,為了收集ImageNet資料集,研究人員花費了數百萬美元的研究經費。雖然目前的資料采內建本已降低了不少,但其成本仍然不可忽略。

另外一種解決辦法是應用遷移學習(transfer learning),将從源資料集學到的知識遷移到目标資料集上。例如,雖然ImageNet資料集的圖像大多跟椅子無關,但在該資料集上訓練的模型可以抽取較通用的圖像特征,進而能夠幫助識别邊緣、紋理、形狀和物體組成等。這些類似的特征對于識别椅子也可能同樣有效。

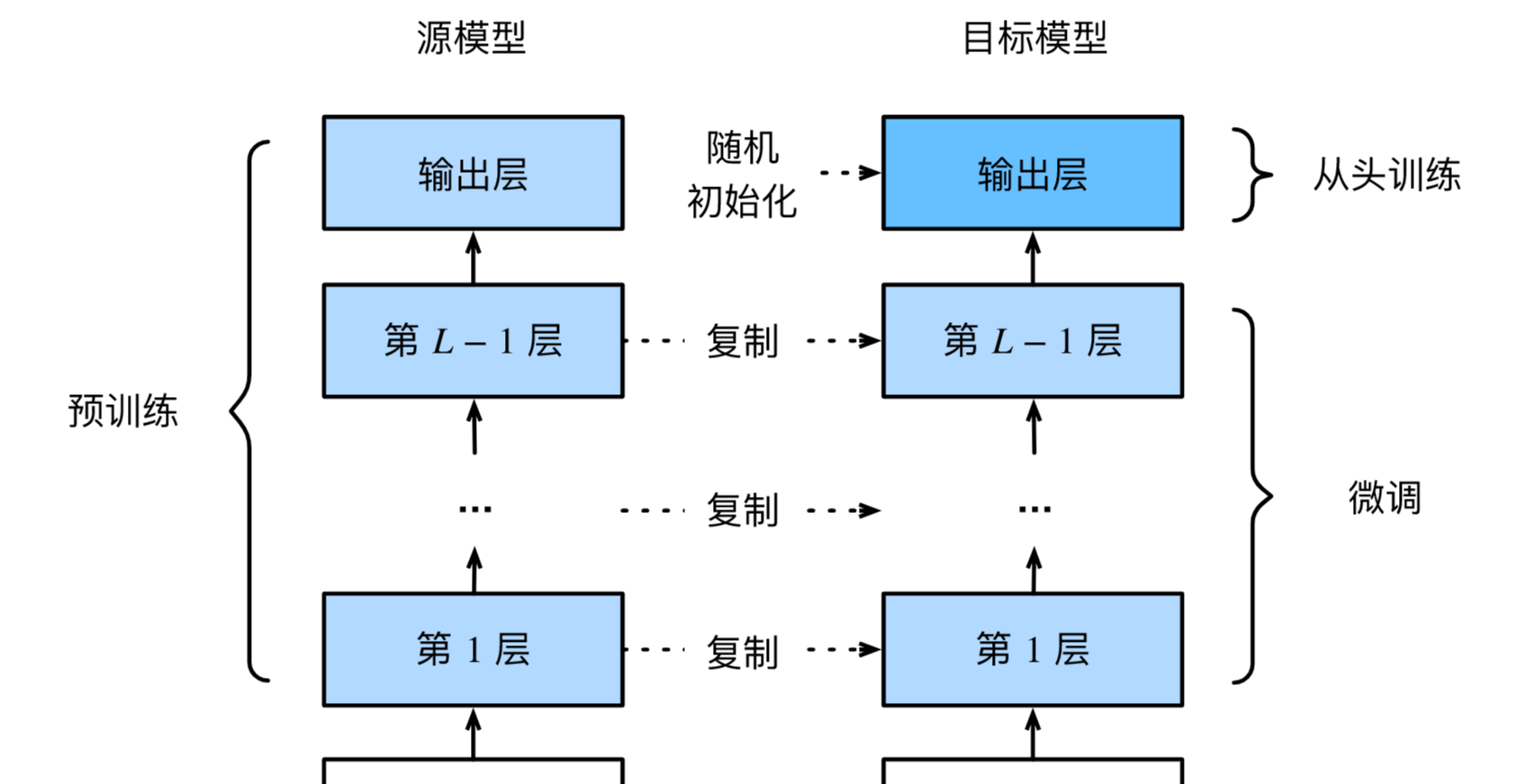

接下來就需要介紹遷移學習中的一種常用技術:微調(fine tuning)。如下圖所示,微調由以下4步構成。

- 在源資料集(如ImageNet資料集)上預訓練一個神經網絡模型,即源模型。

- 建立一個新的神經網絡模型,即目标模型。它複制了源模型上除了輸出層外的所有模型設計及其參數。我們假設這些模型參數包含了源資料集上學習到的知識,且這些知識同樣适用于目标資料集。我們還假設源模型的輸出層跟源資料集的标簽緊密相關,是以在目标模型中不予采用。

- 為目标模型添加一個輸出大小為目标資料集類别個數的輸出層,并随機初始化該層的模型參數。

- 在目标資料集(如椅子資料集)上訓練目标模型。我們将從頭訓練輸出層,而其餘層的參數都是基于源模型的參數微調得到的。

值得注意,但是并不難了解的是,當目标資料集遠小于源資料集時,微調有助于提升模型的泛化能力。

fine tuning的具體例子

接下來我們來實踐一個具體的例子:熱狗識别。我們将基于一個小資料集對在ImageNet資料集上訓練好的ResNet模型進行微調。該小資料集含有數千張包含熱狗和不包含熱狗的圖像。我們将使用微調得到的模型來識别一張圖像中是否包含熱狗。

首先,導入實驗所需的包或子產品。torchvision的models包提供了常用的預訓練模型。如果希望擷取更多的預訓練模型,可以使用使用pretrained-models.pytorch倉庫。

%matplotlib inline

import torch

from torch import nn, optim

from torch.utils.data import Dataset, DataLoader

import torchvision

from torchvision.datasets import ImageFolder

from torchvision import transforms

from torchvision import models

import os

from matplotlib import pyplot as plt

import time

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

擷取資料集

點選下載下傳熱狗資料集,它含有1400張包含熱狗的正類圖像,和同樣多包含其他食品的負類圖像。各類的1000張圖像被用于訓練,其餘則用于測試。

我們首先将壓縮後的資料集下載下傳到路徑data_dir之下,然後在該路徑将下載下傳好的資料集解壓,得到兩個檔案夾hotdog/train和hotdog/test。這兩個檔案夾下面均有hotdog和not-hotdog兩個類别檔案夾,每個類别檔案夾裡面是圖像檔案。

data_dir = './data_set'

os.listdir(os.path.join(data_dir, "hotdog")) # ['train', 'test']

建立兩個ImageFolder執行個體來分别讀取訓練資料集和測試資料集中的所有圖像檔案。

train_imgs = ImageFolder(os.path.join(data_dir, 'hotdog/train'))

test_imgs = ImageFolder(os.path.join(data_dir, 'hotdog/test'))

畫出前8張正類圖像和最後8張負類圖像。可以看到,它們的大小和高寬比各不相同。

def show_images(imgs, num_rows, num_cols, scale=2):

figsize = (num_cols * scale, num_rows * scale)

_, axes = plt.subplots(num_rows, num_cols, figsize=figsize)

for i in range(num_rows):

for j in range(num_cols):

axes[i][j].imshow(imgs[i * num_cols + j])

axes[i][j].axes.get_xaxis().set_visible(False)

axes[i][j].axes.get_yaxis().set_visible(False)

return axes

hotdogs = [train_imgs[i][0] for i in range(8)]

not_hotdogs = [train_imgs[-i - 1][0] for i in range(8)]

show_images(hotdogs + not_hotdogs, 2, 8, scale=1.4);

- 在訓練時,我們先從圖像中裁剪出随機大小和随機高寬比的一塊随機區域,然後将該區域縮放為高和寬均為224像素的輸入。

- 測試時,我們将圖像的高和寬均縮放為256像素,然後從中裁剪出高和寬均為224像素的中心區域作為輸入。

-

此外,我們對RGB(紅、綠、藍)三個顔色通道的數值做标準化:每個數值減去該通道所有數值的平均值,再除以該通道所有數值的标準差作為輸出。

指定RGB三個通道的均值和方差來将圖像通道歸一化

# 指定RGB三個通道的均值和方差來将圖像通道歸一化

normalize = transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

train_augs = transforms.Compose([

transforms.RandomResizedCrop(size=224),

transforms.RandomHorizontalFlip(),

transforms.ToTensor(),

normalize

])

test_augs = transforms.Compose([

transforms.Resize(size=256),

transforms.CenterCrop(size=224),

transforms.ToTensor(),

normalize

])

需要注意的是:在使用預訓練模型時,一定要和預訓練時作同樣的預處理

定義和初始化模型

使用在ImageNet資料集上預訓練的ResNet-18作為源模型。這裡指定pretrained=True來自動下載下傳并加載預訓練的模型參數。在第一次使用時需要聯網下載下傳模型參數。

pretrained_net = models.resnet18(pretrained=True)

不管你是使用的torchvision的models還是pretrained-models.pytorch倉庫,預設都會将預訓練好的模型參數下載下傳到你的home目錄下.torch檔案夾。你可以通過修改環境變量TORCH_MODEL_ZOO來更改下載下傳目錄: export TORCH_MODEL_ZOO="/local/pretrainedmodels" 。

另外比較常使用的方法是,在其源碼中找到下載下傳位址直接浏覽器輸入位址下載下傳,下載下傳好後将其放到環境變量$TORCH_MODEL_ZOO所指檔案夾即可,這樣比較快。

列印源模型的成員變量fc。作為一個全連接配接層,它将ResNet最終的全局平均池化層輸出變換成ImageNet資料集上1000類的輸出。

print(pretrained_net.fc)

如果你使用的是其他模型,那可能沒有成員變量fc(比如models中的VGG預訓練模型),是以正确做法是檢視對應模型源碼中其定義部分,這樣既不會出錯也能加深我們對模型的了解。

可見此時pretrained_net最後的輸出個數等于目标資料集的類别數1000。是以我們應該将最後的fc成修改我們需要的輸出類别數:

pretrained_net.fc = nn.Linear(512, 2)

print(pretrained_net.fc)

此時,pretrained_net的fc層就被随機初始化了,但是其他層依然儲存着預訓練得到的參數。由于是在很大的ImageNet資料集上預訓練的,是以參數已經足夠好,是以一般隻需使用較小的學習率來微調這些參數,而fc中的随機初始化參數一般需要更大的學習率從頭訓練。

output_params = list(map(id, pretrained_net.fc.parameters()))

feature_params = filter(lambda p: id(p) not in output_params, pretrained_net.parameters())

lr = 0.01

optimizer = optim.SGD([{'params': feature_params},

{'params': pretrained_net.fc.parameters(), 'lr': lr * 10}],

lr=lr, weight_decay=0.001)

微調模型

def train(train_iter, test_iter, net, loss, optimizer, device, num_epochs):

net = net.to(device)

print("training on ", device)

batch_count = 0

for epoch in range(num_epochs):

train_l_sum, train_acc_sum, n, start = 0.0, 0.0, 0, time.time()

for X, y in train_iter:

X = X.to(device)

y = y.to(device)

y_hat = net(X)

l = loss(y_hat, y)

optimizer.zero_grad()

l.backward()

optimizer.step()

train_l_sum += l.cpu().item()

train_acc_sum += (y_hat.argmax(dim=1) == y).sum().cpu().item()

n += y.shape[0]

batch_count += 1

test_acc = evaluate_accuracy(test_iter, net)

print('epoch %d, loss %.4f, train acc %.3f, test acc %.3f, time %.1f sec'

% (epoch + 1, train_l_sum / batch_count, train_acc_sum / n, test_acc, time.time() - start))

def train_fine_tuning(net, optimizer, batch_size=128, num_epochs=5):

train_iter = DataLoader(ImageFolder(os.path.join(data_dir, 'hotdog/train'), transform=train_augs),

batch_size, shuffle=True)

test_iter = DataLoader(ImageFolder(os.path.join(data_dir, 'hotdog/test'), transform=test_augs),

batch_size)

loss = torch.nn.CrossEntropyLoss()

train(train_iter, test_iter, net, loss, optimizer, device, num_epochs)

開始訓練(微調)

train_fine_tuning(pretrained_net, optimizer)

- 遷移學習将從源資料集學到的知識遷移到目标資料集上。微調是遷移學習的一種常用技術。

- 目标模型複制了源模型上除了輸出層外的所有模型設計及其參數,并基于目标資料集微調這些參數。而目标模型的輸出層需要從頭訓練。

- 一般來說,微調參數會使用較小的學習率,而從頭訓練輸出層可以使用較大的學習率。